DeepSeekの何がすごい?低コストの理由とともに解説

- 2025年2月27日

- 読了時間: 6分

更新日:2月5日

中国のAI開発企業より2025年1月にリリースされたDeepSeek R1が多くの注目を集めています。

世界中のメディアでも多く取り上げられ、ChatGPTのOpenAI社や、LlamaのMeta社の性能を上回る大規模言語モデルを開発したとも言われています。

しかし多くの注目が集まる理由がわからない方も多いのではないでしょうか。 本記事ではDeepSeekの概要とともに、注目されている理由、低コストと言われる要因を解説していきます。

<目次>

DeepSeekとは

もともとは2023年に中国・杭州で設立された企業です。大希望言語モデル(LLM)の開発会社として、特に2025年1月にリリースされたモデルDeepSeek R1が多くの注目を集めています。 このモデルをリリース後、 約1ヶ月でDeepSeekApp の累計ダウンロード数は 1.1 億回を超えています。現在ユーザー数4億人を超えるChatGPTと比較しても、1億ダウンロードは2ヶ月ほどで達成しているため、急速な増加傾向です。

モデルの種類

DeepSeekからリリースされているモデルは代表的なもので2つあります。それぞれ解説していきます。

DeepSeek V3

1つ目は2024年12月に公開されたモデルの「DeepSeek V3」です。

プログラミングや数学を得意とするモデルで、パラメーター数は6710億個とされています。

このモデルは、大規模なテキストデータを学習することで、より高度な言語パターンを理解し、応用できるよう設計されています。また、事前学習には14兆ものトークンを活用しており、その膨大なデータをもとに高精度な自然言語処理を実現しています。

パラメータとは変数という意味で、回答までのパラメータ数が増えることにより毎回異なる内容を受け渡しているため、回答の精度が高くなるという意味になります。

DeepSeek R1

そしてV3の公開から約1ヶ月後の2025年1月、話題の新モデル「DeepSeek R1」がリリースされました。

V3と同様、プログラミングや数学を得意とすることに加えて、大規模な強化学習(RL)が持ちられ推論力も優れています。

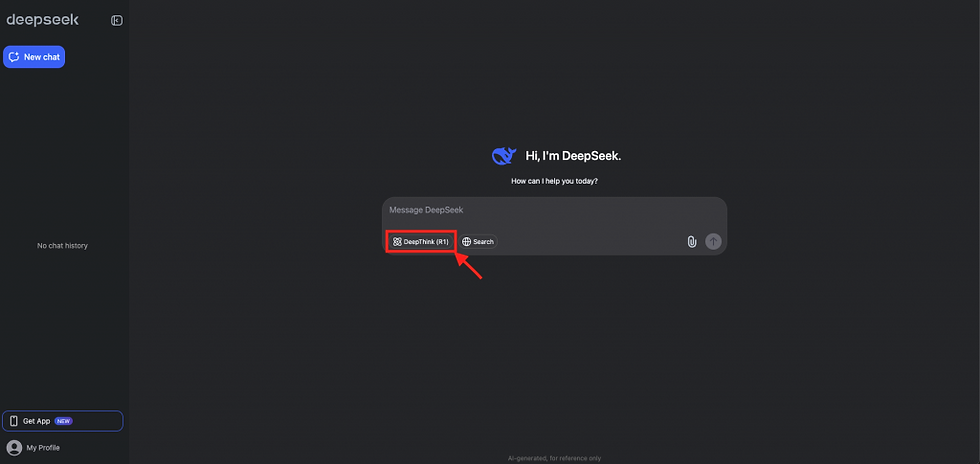

こちらのモデルで生成AIチャットアプリがリリースされており、サービスにアカウント登録をすることで利用することができます。ログイン後は「DeepThink」を有効にすることで、AIが苦手としている論理的な推論も高度な回答を導き出せることが確認されています。

ChatGPTを利用したことがある方は既視感があると感じるのではないでしょうか。操作性にも特に大きな違いはありません。

DeepSeekが注目される理由

DeepSeekのサービスについて注目される主な理由を3つ紹介していきます。

優れた処理能力

2つのモデルを紹介した通り、DeepSeekは優れた処理能力を備えています。以下の資料はDeepSeekがベンチマーク情報を公開したものです。

参考:DeepSeek

左から4つまでは数学やプログラミング、科学問題などで検証した結果で、右2つはLLMの性能を多面的に評価するために設計された「MMLU」とモデルのエンジニアリング能力をより適切に評価するための指標「SWE-bench Verified」を示しています。推論タスクも得意とする理由がこの結果からわかります。

ほとんどの指標はOpen AI-o1-1217と変わらない評価結果となり、OpenAIに匹敵するといわれている理由です。

OpenAIの蒸留疑惑

OpenAIはニューヨーク・タイムズの取材で、DeepSeekが自社のデータを不正に利用して独自のAIモデルを開発した可能性があると主張しています。

OpenAIは蒸留を利用規約違反とし、Microsoftとともに調査を始めています。現時点での調査結果はまだ出ていませんが、決定的な技術的証拠は公開されていません。しかし「DeepSeekの蒸留の証拠をいくつか発見した」と明かしていたり、米政府関係者も「OpenAIモデルの出力を蒸留したという実質的な証拠がある」と述べている情報もあります。今後の動きにも注目していきたいですね。

蒸留とは

AIにおける蒸留は、高度なAIモデル「教師モデル」が生成した出力を活用し、よりコンパクトなモデル「生徒モデル」の学習と精度向上を行う手法です。この技術を用いることで、高性能なLLMを低コストかつ効率的に構築できるようになります。

低コストである

蒸留だから低コストで開発できたのではないか、と言われていますが、いろいろな側面で低コストと言われています。次の章で詳しく解説していきます。

DeepSeekが低コストといわれる要因

ここではDeepSeekが低コストといわれる要因を3つ説明していきます。

モデルの開発費用

まずは前述でも述べた通り、開発費用のコストの低さです。DeepSeekの開発費用は前モデルのV3で約560万ドルです。OpenAIなどの米国AI開発企業のほとんどは数億から10億ドルと言われているため、約10分の1の費用で開発されています。

低コスト開発を実現した理由は主に2つです。

最小限のGPU

MoEを採用

最小限のGPU

LLMの学習には大量のGPUが必要とされています。NVIDIAの「H100」などの最先端GPUを最低でも数万個の購入を要します。

しかしDeepSeekはNVIDIAの「H800」という性能がやや劣るGPUをわずか2048個しか使わずに、OpenAIの「GPT-4o」や「o1」とほぼ同等の性能を持つLLMを開発しました。

MoEを採用

MoEは、Mixture of Experts(複数の専門家)の略で、効率的な実現に寄与する技術です。

LLMのように、モデル全体の稼働ではなく「専門家」と呼ばれる部分モデルだけを動かす仕組みで、必要に応じて特定のタスクを最適化します。DeepSeekはこの技術を採用しており、開発コストを抑えています。

無料のサービス

DeepSeek R1は無料で利用することができます。リリースから間もない段階で、各社のLLMに引けを取らない高性能なものであるのにも関わらず、無料で利用できる点はダウンロード数が急速に伸びた要因でしょう。現在は無料プランのみの提供ですが、今後はChatGPTと同様に有料プランのリリースの可能性もありそうです。

オープンソースLLM

DeepSeekは高性能でありながらオープンソース化されています。生成AIを活用した開発をしたい技術者や企業は、低コストでシステム開発が実現できます。OpenAIはChatGPTのほとんどのモデルをオープンソース化していません。この点でも低コストと言われる要因の一つでしょう。

オープンソースとは

オープンソースとは、ソースコードが公開されているソフトウェアを指します。また、誰でも自由に無料で利用できるだけでなく、ソースコードの改変や再配布も可能なソフトウェアを指します。またソースコードやアーキテクチャ、学習済みの重みなどが公開されているものです。

まとめ

DeepSeekについて解説してきましたが、いかがでしたでしょうか。 リリースから間もない状況で高性能さもありますが、OpenAIの蒸留疑惑も世界中から注目される理由の一つです。生成AIに限らず新しいサービスを利用するには注意が必要ですが、DeepSeekの怪しさを感じつつ、利用してみようかなと少しだけ思った方も多いのではないでしょうか。 利用規約やプライバシーポリシーをしっかり読んでから利用し、生成AIをうまく活用していきましょう。